共计 3668 个字符,预计需要花费 10 分钟才能阅读完成。

| 导读 | “ 伪分布式 ” 是指在一个机器上,即当 namenode,又当 datanode, 或者说即是 jobtracker, 又是 tasktracker。没有所谓的在多台机器上进行真正的分布式计算。 |

安装包链接: https://pan.baidu.com/s/1i6oNmOd 密码: i6nc

环境准备

修改 hostname:

$ sudo vi /etc/hostname

修改 IP 地址:

| $ sudo vi /etc/network/interfaces | |

| auto eth0 | |

| iface eth0 inet static | |

| address 192.16.13.11 | |

| netmask 255.255.255.0 | |

| gateway 192.16.13.254 |

重启网络服务生效:

$ sudo ifdown eth0 && sudo ifup eth0

修改 ip 与主机名的对应关系:

| $ sudo vi /etc/hosts | |

| 192.16.13.11 why |

| $ sudo useradd -m hadoop -s /bin/bash #创建 hadoop 用户,并使用 /bin/bash 作为 shell | |

| $ sudo passwd hadoop #为 hadoop 用户设置密码,输入两次 | |

| $ sudo adduser hadoop sudo #为 hadoop 用户增加管理员权限,方便部署 | |

| $ su - hadoop #将当前用户切换到 hadoop 用户 | |

| $ sudo apt-get update #更新 hadoop 用户的 apt, 方便后续软件安装 |

| sudo apt-get install openssh-server #ubuntu 默认安装了 SSH client, 此处安装 SSH server | |

| $ ssh-keygen -t rsa | |

| $ sudo localhost #登陆 SSH,第一次登陆输入 yes | |

| $ exit #退出登录的 ssh localhost | |

| $ cat ./id_rsa.pub >> ./authorized_keys #加入授权 | |

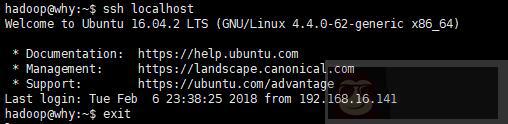

| $ ssh localhost #无需密码登陆,可看到如下界面 |

$ sudo tar zxvf jdk-8u92-linux-x64.tar.gz -C /usr/lib #/ 解压到 /usr/lib/jvm 目录下

| $ cd /usr/lib/jvm #进入该目录 | |

| $ mv jdk1.8.0_92 java #重命名为 java | |

| $ vi ~/.bashrc #给 JDK 配置环境变量 | |

| export JAVA_HOME=/usr/lib/jvm/java | |

| export JRE_HOME=${JAVA_HOME}/jre | |

| export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib | |

| export PATH=${JAVA_HOME}/bin:$PATH | |

| $ source ~/.bashrc #使新配置的环境变量生效 | |

| $ java -version #检测是否安装成功,查看 java 版本 |

| $ sudo tar -zxvf hadoop-2.6.2.tar.gz -C /usr/local #解压到 /usr/local 目录下 | |

| $ cd /usr/local | |

| $ sudo mv hadoop-2.6.2 hadoop #重命名为 hadoop | |

| $ sudo chown -R hadoop ./hadoop #修改文件权限 | |

| $ vi ~/.bashrc | |

| export HADOOP_HOME=/usr/local/hadoop | |

| export CLASSPATH=$($HADOOP_HOME/bin/hadoop classpath):$CLASSPATH | |

| export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native | |

| export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin | |

| $ source ~/.bashrc #使新配置的环境变量生效 |

Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是 HDFS 中的文件。Hadoop 的配置文件位于 /usr/local/hadoop/etc/hadoop/ 中,伪分布式需要修改 2 个配置文件 core-site.xml 和 hdfs-site.xml。Hadoop 的配置文件是 xml 格式,每个配置以声明 property 的 name 和 value 的方式来实现。

首先将 jdk 的路径添(export JAVA_HOME=/usr/lib/jvm/java)加到 hadoop-env.sh 文件

接下来修改 core-site.xml 文件:

| hadoop.tmp.dir | |

| file:/usr/local/hadoop/tmp | |

| Abase for other temporary directories. | |

| fs.defaultFS | |

| hdfs://localhost:9000 |

接下来修改配置文件 hdfs-site.xml

| dfs.replication | |

| dfs.namenode.name.dir | |

| file:/usr/local/hadoop/tmp/dfs/name | |

| dfs.datanode.data.dir | |

| file:/usr/local/hadoop/tmp/dfs/data |

修改 slaves , 添加节点名 why

Hadoop 的运行方式是由配置文件决定的(运行 Hadoop 时会读取配置文件),因此如果需要从伪分布式模式切换回非分布式模式,需要删除 core-site.xml 中的配置项。此外,伪分布式虽然只需要配置 fs.defaultFS 和 dfs.replication 就可以运行(可参考官方教程),不过若没有配置 hadoop.tmp.dir 参数,则默认使用的临时目录为 /tmp/hadoo-hadoop,而这个目录在重启时有可能被系统清理掉,导致必须重新执行 format 才行。所以我们进行了设置,同时也指定 dfs.namenode.name.dir 和 dfs.datanode.data.dir,否则在接下来的步骤中可能会出错。

配置完成后,执行 NameNode 的格式化

$ ./bin/hdfs namenode -format

启动 namenode 和 datanode 进程,并查看启动结果

| $ ./sbin/start-dfs.sh | |

| $ jps |

启动完成后,可以通过命令 jps 来判断是否成功启动,若成功启动则会列出如下进程:“NameNode”、”DataNode”和“SecondaryNameNode”

| sudo tar -zxf hbase-1.1.2-hadoop2-bin.tar.gz -C/usr/local #解压到 usr/local 目录下 | |

| $ cd /usr/local | |

| $ mv ./hbase-1.1.2-hadoop2 ./hbase #重命名 | |

| $ sudo chown -R hadoop:hadoop ./hbase #修改权限 |

配置命令行环境变量 /etc/profile

| export HBASE_HOME=/usr/local/hbase | |

| export PATH=$HBASE_HOME/bin:$PATH | |

| 修改 hbase 的配置文件 /conf/hbase-env.sh | |

| export JAVA_HOME=/usr/lib/jvm/java | |

| export HBASE_MANAGES_ZK=true |

编辑.xml 配置文件 conf/hbase-site.xml

| hbase.rootdir | |

| hdfs://localhost:9000/hbase | |

| 数据存放的位置。hbase.cluster.distributed | |

| hbase.zookeeper.quorum | |

| localhost | |

| dfs.replication |

指定副本个数为 1,因为伪分布式。

说明

| hbase.rootdir 配置在 hdfs 文件系统上 hbase 存储的路径 | |

| hbase.cluster.distributed 配置是否是分布式的 | |

| hbase.zookeeper.quorum 配置 zookeeper 在哪个节点上 | |

| dfs.replication 配置副本个数 |

注意:hbase.rootdir 的主机和端口号与 hadoop 的配置文件 core-site.xml 的 fs.default.name 的主机和端口号一致

启动 hbase,在 bin 目录下执行命令 start-hbase.sh

启动 hbase 之前,确保 hadoop 是运行正常的,并且可以写入文件 *

| sudo tar -zxf phoenix-4.7.0-HBase-1.1-bin.tar.gz -C/usr/local #解压到 usr/local 目录下 | |

| $ cd /usr/local |

把 hbase-site.xml 考到 phoenix ./bin 目录下

把 phoenix-4.7.0-HBase-1.1-server.jar 包考到 hbase ./lib 下