共计 4947 个字符,预计需要花费 13 分钟才能阅读完成。

Hadoop 集群有三种运行模式:单机模式、伪分布模式、完全分布模式。我们这里搭建第三种完全分布模式,即使用分布式系统,在多个节点上运行。

1

1.1

# vim /etc/hosts

10.0.0.45 master

10.0.0.46 slave1

10.0.0.47 slave21.2

# service iptables stop // 关闭服务 # chkconfig iptables off // 关闭开机自启动 1.3

# ssh-keygen -t rsa // 输入命令之后连续回车就行了 (2)在主节点上,将公钥拷贝到一个特定文件中:

[root@master .ssh]# cp id_rsa.pub authorized_keys(3)将每个从节点上生成的公钥复制到主节点上:

[root@slave1 .ssh]# scp id_rsa.pub master:/root/.ssh/id_rsa_slave1.pub

[root@slave2 .ssh]# scp id_rsa.pub master:/root/.ssh/id_rsa_slave2.pub(4)在主节点上合并从节点的公钥:

[root@master .ssh]# cat id_rsa_slave1.pub>>authorized_keys

[root@master .ssh]# cat id_rsa_slave2.pub>>authorized_keys(5)将主节点上合并后的公钥复制到从节点上:

[root@master .ssh]# scp authorized_keys slave1:/root/.ssh[root@master .ssh]# scp authorized_keys slave2:/root/.ssh

1.4

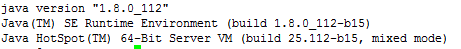

# vim /etc/profile

export JAVA_HOME=/usr/java/jdk1.8.0_112

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$PATH:$JAVA_HOME/bin

# source /etc/profile // 使配置生效

# java -vesrion

2

2.1

# tar xvf hadoop-2.7.3.tar.gz

# vim /etc/profile

export HADOOP_HOME=/home/hadoop-2.7.3

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

export HADOOP_CONF_DIR=${HADOOP_HOME}/etc/hadoop2.2

-

core-site.xml

- hdfs-site.xml

- yarn-site.xml

- mapred-site.xml

- slaves、hadoop-env.sh、yarn-env.sh

下面就介绍文件的具体配置,按实际情况修改配置信息:

(1)core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop _tmp</value>

</property>

</configuration>(2)hdfs-site.xml

<configuration>

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

<property>

<name>dfs.support.append</name>

<value>true</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///home/dfs_data</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///home/dfs_name</value>

</property>

<property>

<name>dfs.namenode.rpc-address</name>

<value>master:9000</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>slave1:50090</value>

</property>

<property>

<name>dfs.namenode.secondary.https-address</name>

<value>slave1:50091</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

</configuration>(3)yarn-site.xml

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>20480</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>10240</value>

</property>

<property>

<name>yarn.nodemanager.resource.cpu-vcores</name>

<value>5</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

</configuration>(4)mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>(5)slaves

slave1

slave2(6)hadoop-env.sh

export JAVA_HOME=/usr/java/jdk1.8.0_112(7)yarn-env.sh

export JAVA_HOME=/usr/java/jdk1.8.0_112

# scp /home/hadoop-2.7.3/etc/hadoop/* slave1:/home/hadoop-2.7.3/etc/hadoop/# scp /home/hadoop-2.7.3/etc/hadoop/* slave2:/home/hadoop-2.7.3/etc/hadoop/2.3

(1)第一次启动 HDFS 时需要初始化,在主节点上执行:

# cd /home/hadoop-2.7.3

# ./bin/hadoop namenode -format(2)启动 HDFS:

# ./sbin/start-dfs.sh

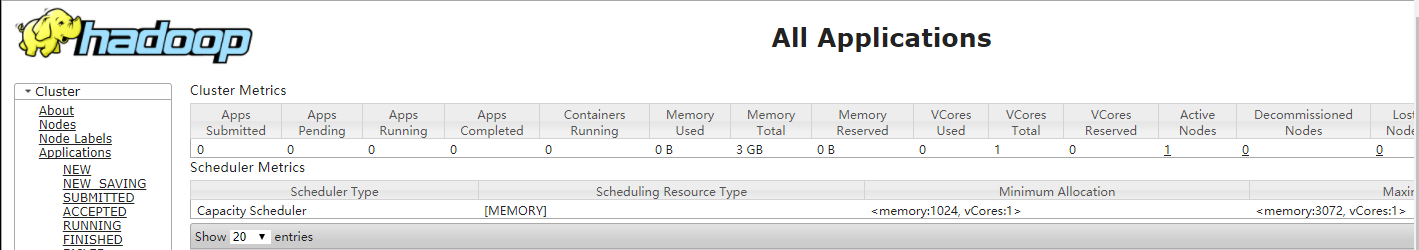

(3)启动 YARN:

# ./sbin/start-yarn.sh

# start-all.sh

Hadoop 项目之基于 CentOS7 的 Cloudera 5.10.1(CDH)的安装部署

Hadoop2.7.2 集群搭建详解(高可用)

使用 Ambari 来部署 Hadoop 集群(搭建内网 HDP 源)

Ubuntu 14.04 下 Hadoop 集群安装

CentOS 6.7 安装 Hadoop 2.7.2

Ubuntu 16.04 上构建分布式 Hadoop-2.7.3 集群

CentOS 7.3 下 Hadoop2.8 分布式集群安装与测试

CentOS 7 下 Hadoop 2.6.4 分布式集群环境搭建

Hadoop2.7.3+Spark2.1.0 完全分布式集群搭建过程

更多 Hadoop 相关信息见 Hadoop 专题页面 http://www.linuxidc.com/topicnews.aspx?tid=13

本文永久更新链接地址 :http://www.linuxidc.com/Linux/2018-02/150706.htm