共计 1593 个字符,预计需要花费 4 分钟才能阅读完成。

一、Hadoop 的安装

1. 下载地址:https://archive.apache.org/dist/hadoop/common/ 我下载的是 hadoop-2.7.3.tar.gz 版本。

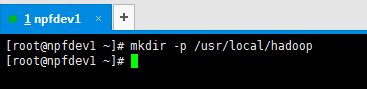

2. 在 /usr/local/ 创建文件夹 zookeeper

mkdir hadoop

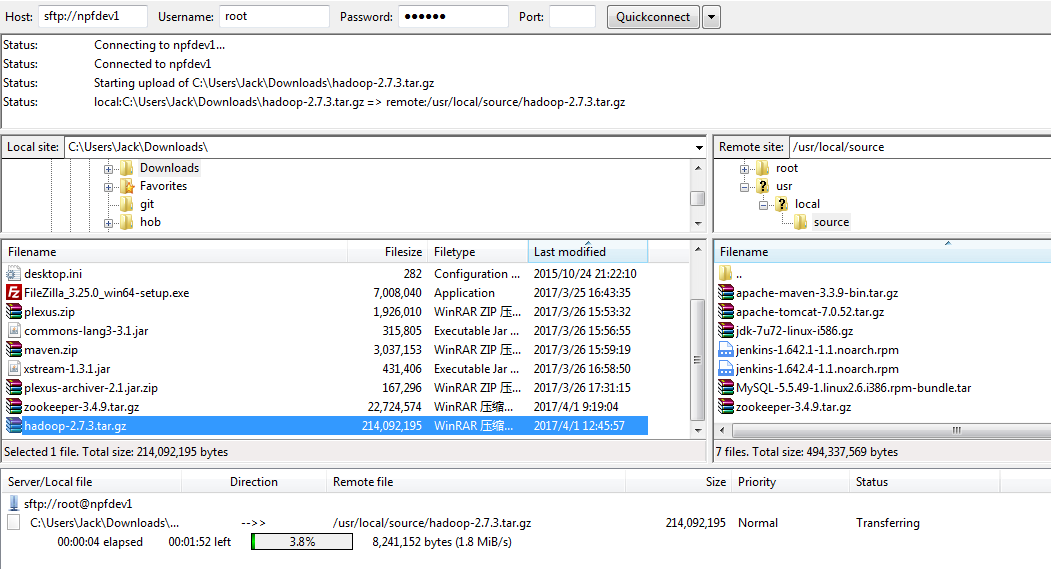

3. 上传文件到 Linux 上的 /usr/local/source 目录下

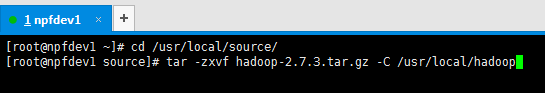

3. 解压缩

运行如下命令:

tar -zxvf hadoop-2.7.3.tar.gz -C /usr/local/hadoop

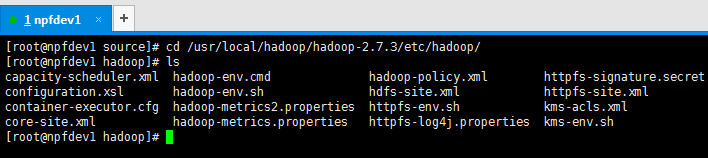

4. 修改配置文件

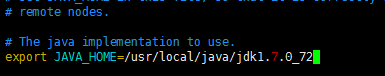

进入到 cd /usr/local/hadoop/hadoop-2.7.3/etc/hadoop/ , 修改 hadoop-env.sh

运行 vim hadoop-env.sh, 修改 Java_HOME

5. 将 Hadoop 的执行命令加入到我们的环境变量里

在 /etc/profile 文件中加入:

export PATH=$PATH:/usr/local/hadoop/hadoop-2.7.3/bin:/usr/local/hadoop/hadoop-2.7.3/sbin

执行 /etc/profile 文件:

source /etc/profile

6. 将 npfdev1 机器上的 hadoop 复制到 npfdev2 和 npfdev3 和 npfdev4 机器上。使用下面的命令:

首先分别在 npfdev2 和 npfdev3 和 npfdev4 机器上,建立 /usr/local/hadoop 目录,然后在 npfdev1 上分别执行下面命令:

scp -r /usr/local/hadoop/hadoop-2.7.3/ npfdev2:/usr/local/hadoop/

scp -r /usr/local/hadoop/hadoop-2.7.3/ npfdev3:/usr/local/hadoop/

scp -r /usr/local/hadoop/hadoop-2.7.3/ npfdev4:/usr/local/hadoop/

记住:需要各自修改 npfdev2 和 npfdev3 和 npfdev4 的 /etc/profile 文件:

在 /etc/profile 文件中加入:

export PATH=$PATH:/usr/local/hadoop/hadoop-2.7.3/bin:/usr/local/hadoop/hadoop-2.7.3/sbin

执行 /etc/profile 文件:

source /etc/profile

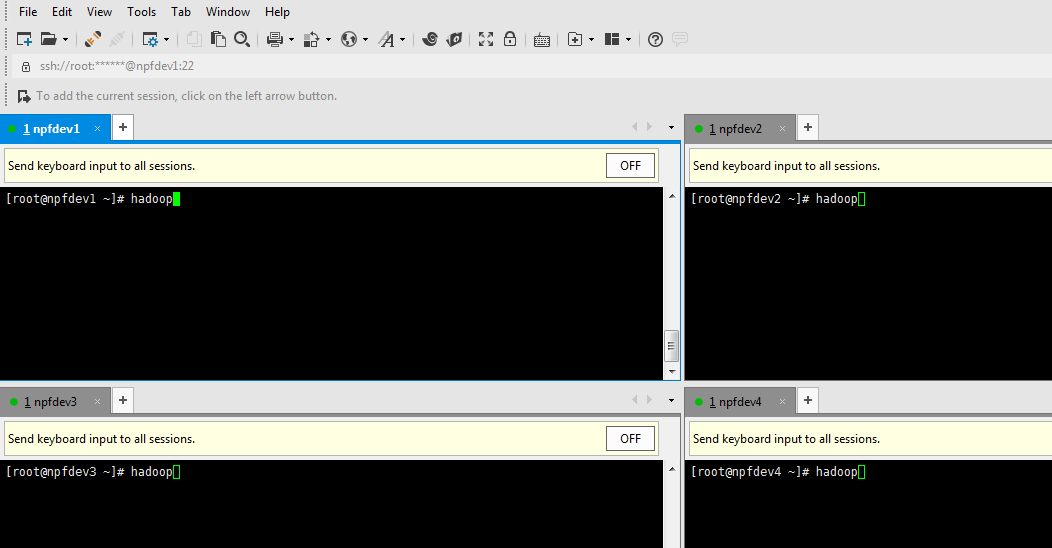

然后分别在 npfdev1 和 npfdev2 和 npfdev3 和 npfdev4 机器上, 执行 hadoop 命令,看是否安装成功。并且关闭防火墙。

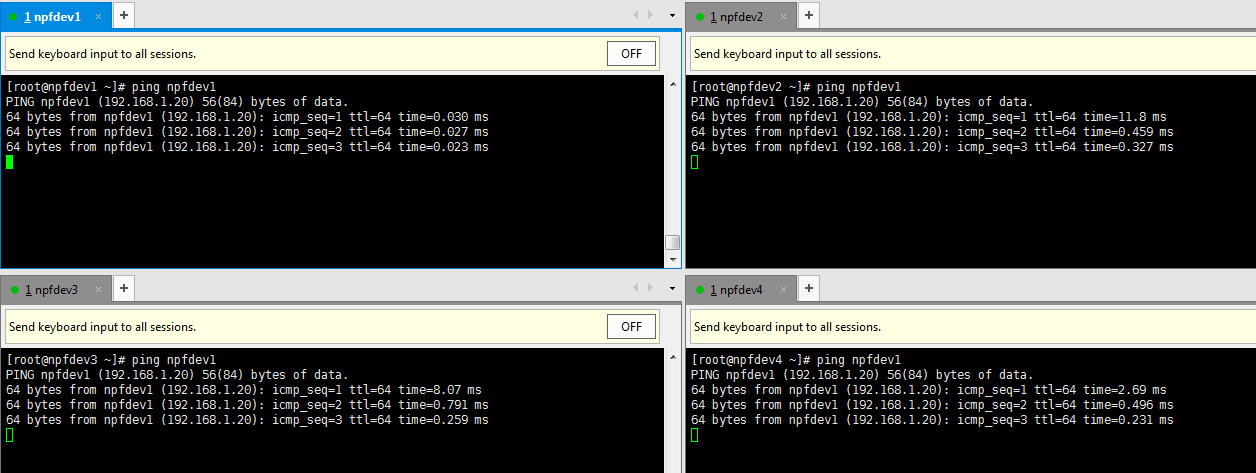

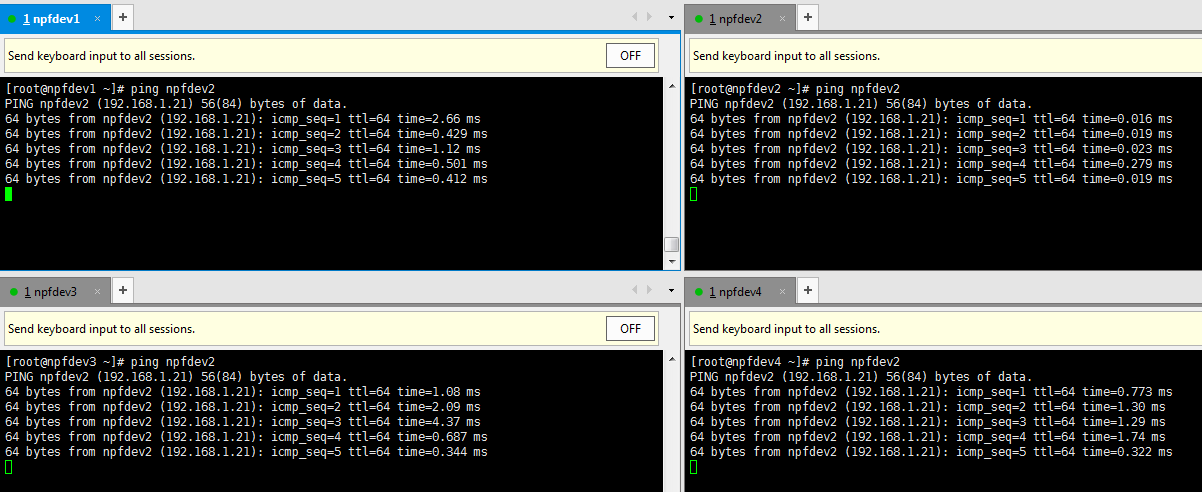

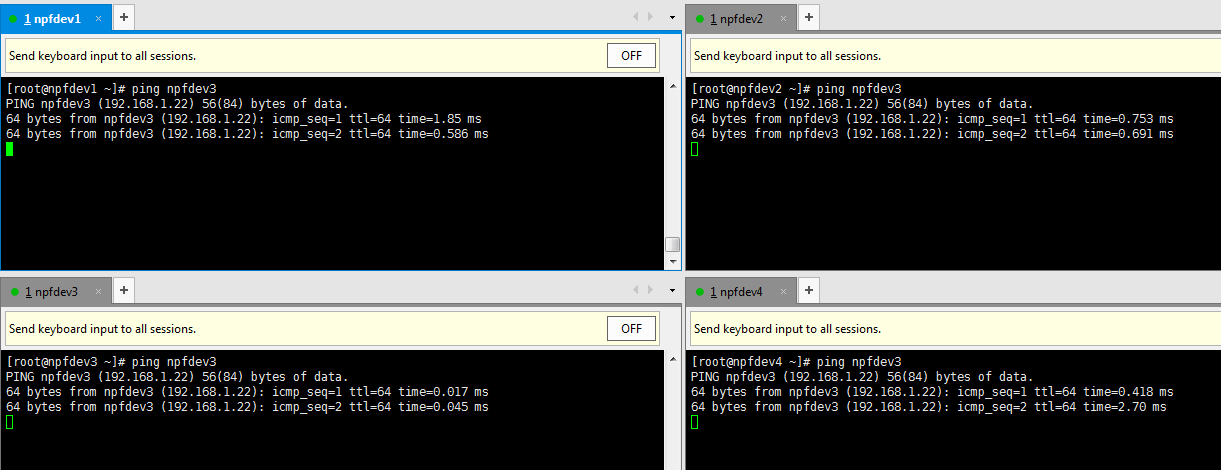

7. 确定所有机器之间可以相互 ping 通,使用下面的命令:

(1). ping npfdev1

(2). ping npfdev2

(3). ping npfdev3

(4). ping npfdev4

8. 启动 hadoop:

我们这里将 npfdev1 作为 master,npfdev2 和 npfdev3 和 npfdev4 分别作为三台 slave。

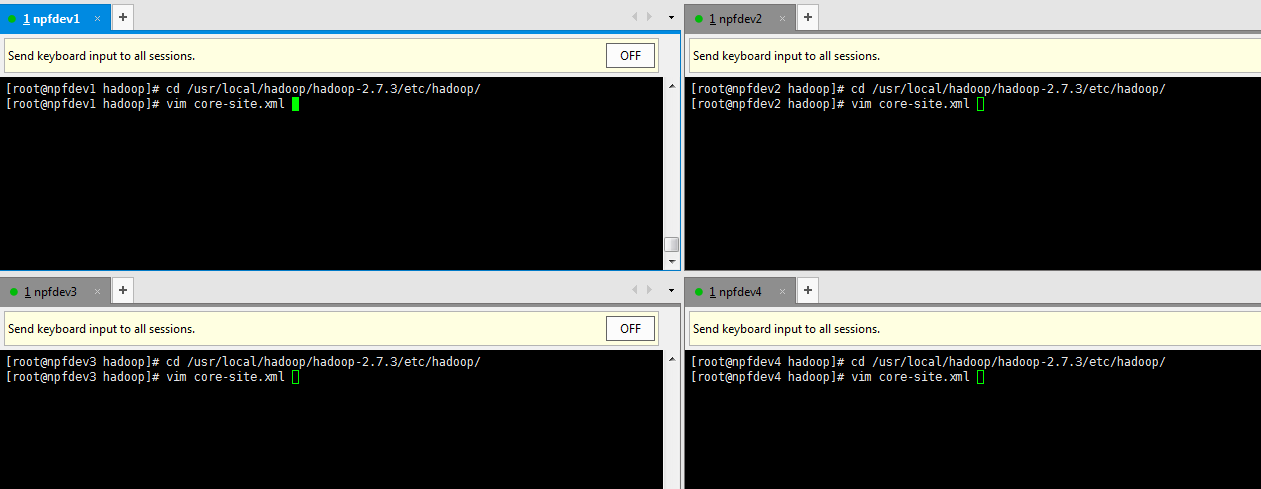

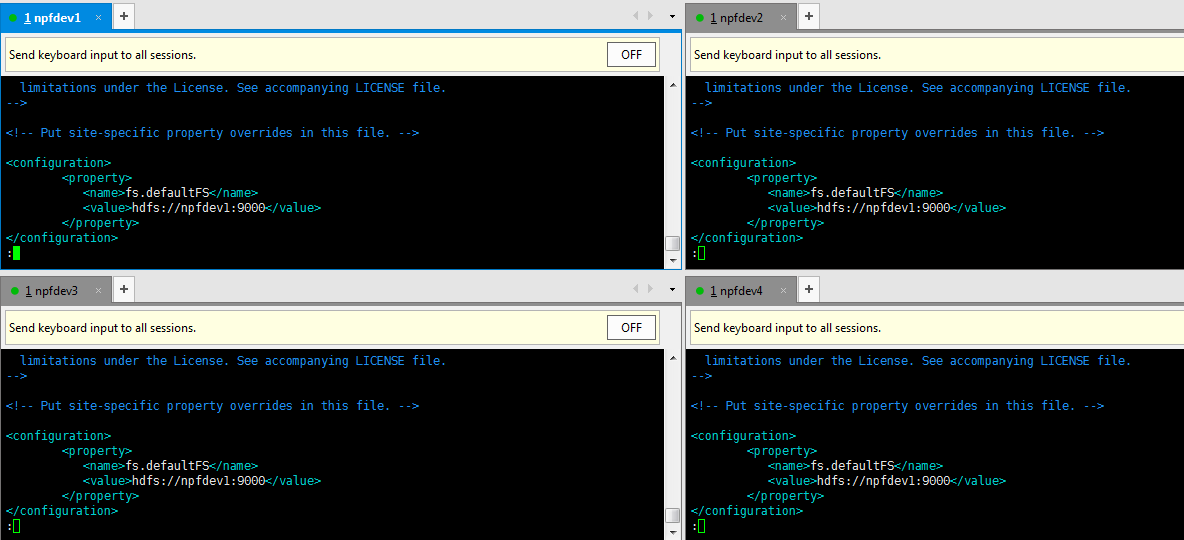

(1). 修改配置文件 core-site.xml

进入 cd /usr/local/hadoop/hadoop-2.7.3/etc/hadoop

具体配置如下:

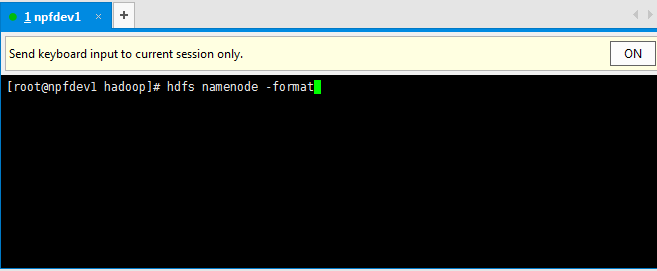

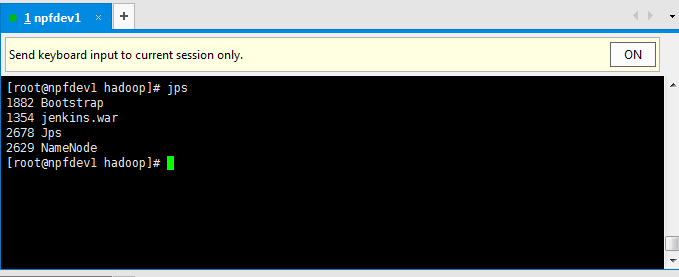

(2). 在 master 机器 npfdev1 上启动 namenode

首先需要格式化 namenode,第一次使用需要格式化,后来就不需要了。

hdfs namenode -format

然后启动 namenode:

hadoop-daemon.sh start namenode

通过 jps 命令查看,如果有 namenode 的 java 进程,就说明我们启动 namenode 成功。

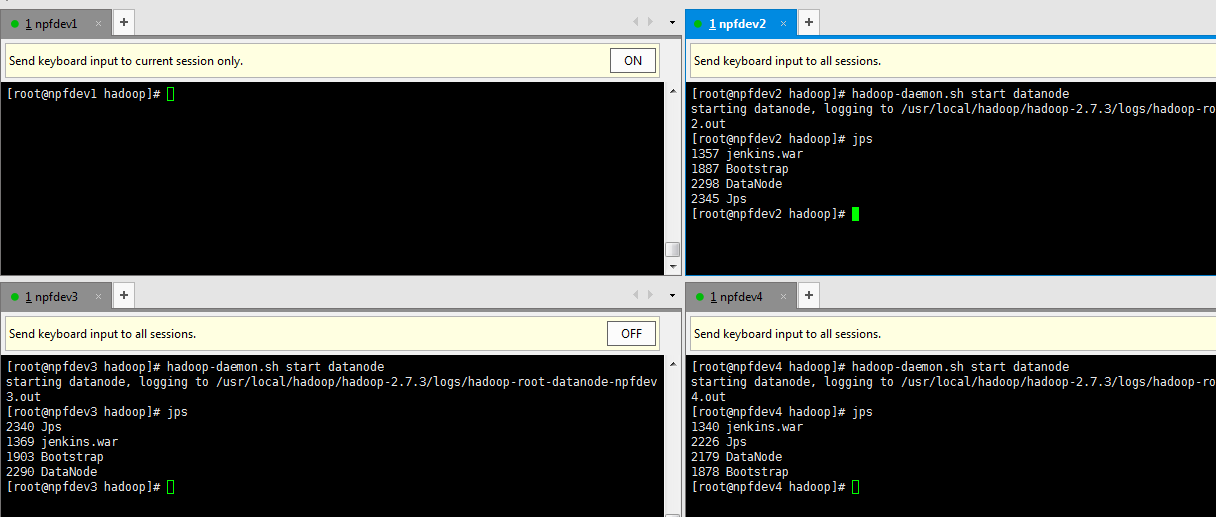

(3). 在 slave 机器 npfdev2,npfdev3,npfdev4 上启动 datanode

更多 Hadoop 相关信息见 Hadoop 专题页面 https://www.linuxidc.com/topicnews.aspx?tid=13

: